Bei einem Hypothesentest wird eine Hypothese geprüft und entweder die Nullhypothese oder die Gegenhypothese als wahr angenommen. Anschliessend stellt sich die Frage, zu welchem Signifikanzniveau die Hypothese angenommen wurde. Eine 100%ige Sicherheit gibt es jedoch nicht. Geht es im Hypothesentest doch darum, aus einzelnen Messwerten Schlussfolgerungen über die dahinter liegende Wahrscheinlichkeitsverteilung zu ziehen. Untersuchen wir z.B. die Wirkung zweier verschiedener Düngermittel auf den Ernteertrag von Bohnen, dann werden wir niemals erfahren, wie die Wahrscheinlichkeitsverteilung verschiedener Erntemengen tatsächlich aussieht, sondern können nur aufgrund der im Feldversuch gemessenen Erntemengen darauf zurückschliessen.

Sollten Sie Unterstützung bei der Erhebung oder Analyse von Daten benötigen, helfen unsere Statistiker Ihnen gerne weiter. Nutzen Sie einfach unser Kontaktformular für eine kostenlose Beratung & ein unverbindliches Angebot – oder rufen Sie uns an.

Bedeutung der statistischen Signifikanz

Die statistische Signifikanz misst den Fehler 1. Art bei einem Hypothesentest. Ein Fehler 1. Art bedeutet, dass eine Hypothese wahr ist, aber trotzdem verworfen wird. Die Wahrscheinlichkeit für einen solchen Fehler wird als a bezeichnet. Die statistische Signifikanz ist 1-a. Beträgt a also 1%, dann beträgt die statistische Signifikanz 99%. Je höher die statistische Signifikanz ist, umso besser, denn umso sicherer ist man, dass die Hypothese, wenn sie richtig ist, auch als richtig erkannt wird. Dies sagt nichts aus über den umgekehrten Fall, nämlich dass die Hypothese, wenn sie falsch wäre, auch als falsch erkannt würde. Die Wahrscheinlichkeit, eine falsche Hypothese als falsch zu erkennen, wird durch die Stärke des Signifikanztests (sog. Teststärke) (1-ss) gemessen, und der Fehler 2. Art, eine falsche Hypothese als richtig anzunehmen beträgt ss.

Man kann auch sagen, dass die statistische Signifikanz die Wahrscheinlichkeit misst, dass ein beobachteter Unterschied zufällig entstanden ist, oder die Sicherheit, mit der eine Stichprobe Rückschlüsse auf die Grundgesamtheit erlaubt.

Was könnte dazu beitragen, dass wir eine richtige Hypothese fälschlicherweise verwerfen? Wenn wir eine zu kleine Stichprobe haben, geben die Messwerte nicht die Wahrscheinlichkeitsverteilung richtig wieder. Durch eine ungeschickte Auswahl der jeweiligen Untersuchungsobjekten kann es passieren, dass unkontrollierte Effekte die Messergebnisse verfälschen. Beispielsweise wenn wir zufällig für die eine Gruppe besonders gesunde Bohnen erwischt haben und für die andere kranke? Je mehr Bohnen im Experiment verwendet werden, umso unwahrscheinlicher wird so ein unglücklicher Zufall.

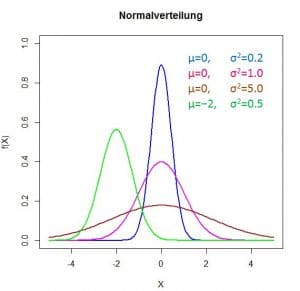

Die statistische Signifikanz hängt auch von den Wahrscheinlichkeitsverteilungen ab. Liegen die Erwartungswerte beider Bohnengruppen nahe beieinander, weil beide Dünger fast denselben Einfluss auf das Bohnenwachstum haben, lässt sich ein geringer vorhandener Unterschied weniger sicher nachweisen. Erschwert wird der Hypothesentest auch dann, wenn die Werte stark um den Erwartungswert streuen, d.h. die Bohnen von Natur aus stark unterschiedliches Wachstum aufweisen. Auch dann lässt sich ein geringer Unterschied statistisch nur schwer belegen.

Die statistische Signifikanz ist umso höher…

- je grösser die Stichprobe: Je mehr Daten zur Verfügung stehen, umso sicherer können wir ausschliessen, dass ein beobachteter Unterschied zwischen den beiden Stichproben zufällig entstanden ist.

- je grösser der Unterschied zwischen den Erwartungswerten der Verteilungen: Je weiter die Erwartungswerte tatsächlich auseinander liegen, umso leichter lässt sich dieser Unterschied aufzeigen.

- je geringer die Standardabweichung der Verteilungen: Je schmaler die Verteilungen, umso weniger streuen die Messwerte, und umso leichter wird ein Unterschied nachweisbar.

Vorgang beim Signifikanztest

Um durch den Signifikanztest die statistische Signifikanz zu berechnen, müssten wir eigentlich die Wahrscheinlichkeitsverteilungen der Messgrössen kennen. Diese haben wir jedoch üblicherweise nicht, denn sonst bräuchten wir keinen Hypothesentest durchzuführen. Es gibt darum zwei Möglichkeiten, die statistische Wahrscheinlichkeitsverteilung herzuleiten: Man macht Annahmen oder man ermittelt sie näherungsweise aus den Messdaten. Beide Verfahren können auch gemischt werden, z.B. indem man den Erwartungswert gleich dem Mittelwert der Messdaten setzt, annimmt die Verteilungen seien gaussverteilt und die Standardabweichung aus der Streuung der Messwerte herleitet. Auch die Hypothese enthält oft Annahmen über die Wahrscheinlichkeitsverteilungen, beispielsweise wenn sie annimmt, die Erwartungswerte beider Stichproben seien gleich.

Unter der Voraussetzung die Hypothese sei wahr und die beiden Wahrscheinlichkeitsverteilungen der Mengen an geernteten Bohnen seien bekannt, lässt sich nun berechnen, mit welcher Wahrscheinlichkeit man die Hypothese fälschlicherweise ablehnen würde. Nimmt man beispielsweise an, die beiden Bohnengruppen würden trotz unterschiedlicher Behandlung gleich gut wachsen, dann untersucht man z.B. den Unterschied der Mittelwerte der beiden Gruppen als Testgrösse. Dieser Unterschied sollte dann durchschnittlich null sein, kann aber aus statistischen Gründen um diesen Mittelwert herum streuen, z.B. entsprechend einer Normalverteilung. Die Testgrösse hätte also eine Verteilung wie in der folgenden Abbildung:

Bei einer Gaussverteilung ist die Wahrscheinlichkeit sehr gering, dass eine Testgrösse sehr weit vom Mittelwert entfernt liegt. Nehmen wir an, wir testen die Nullhypothese H0 “Bohnen, die mit Dünger X gedüngt wurden, tragen weniger als oder gleich viel wie Bohnen, die mit Dünger Y gedüngt wurden”. Tatsächlich wurde ein gewisser Unterschied gemessen: Die mit X gedüngten Bohnen haben im Mittel mehr Ertrag gebracht. Es sieht also zunächst aufgrund der Erntedaten so aus als sei H0 falsch. Nun wollen wir wissen, wie hoch die Wahrscheinlichkeit ist, dass die Hypothese H0 trotzdem richtig ist.

Da wir Annahmen über die Wahrscheinlichkeitsverteilung treffen müssen, nehmen wir an, tatsächlich seien beide Dünger gleich gut. Nur zufällig sieht es so aus als sei Dünger X besser. Nun machen wie einen einseitigen Hypothesentest mit der Testgrösse “Mittelwert X minus Mittelwert Y”. Diese Testgrösse hat den Erwartungswert null und sei gaussverteilt mit einer Standardabweichung, die wir näherungsweise aus den Messwerten berechnen. Nun kann anhand von Tabellen der Gaussverteilung ermittelt werden, mit welcher Wahrscheinlichkeit zufällig die Testgrösse trotz gültiger Hypothese H0 so gross (positiv) geworden ist wie wir sie gemessen haben.

Praktisch geht man meist umgekehrt vor: Man bestimmt erst die statistische Signifikanz, die man erreichen möchte, z.B. 95%. Dann weiss man, dass die normierte Testgrösse bei einer Normalverteilung mit 95%iger Wahrscheinlichkeit rechts von µ+1,645s liegen wird, wobei µ den Erwartungswert der Testgrösse bezeichnet und s die Standardabweichung. Liegt unsere Testgrösse also rechts von diesem Wert, im Ablehnungsbereich, lehnen wir die Hypothese H0 mit der statistischen Signifikanz 95% ab.