Wenn wir uns über statistische Verfahren, medizinische Studien Machine Learning informieren, begegnen wir früher oder später der Diskussion zwischen Bayes Statistik und klassischer frequentistischer Statistik. Gleichzeitig fällt es vielen Anwendern schwer zu verstehen, worin sich beide Ansätze tatsächlich unterscheiden und welche praktischen Konsequenzen sich daraus ergeben.

Genau hier setzt dieser Beitrag an: Wir erklären die Grundlagen der Bayes Statistik einfach und verständlich, zeigen die Unterschiede zur frequentistischen Statistik und erläutern anhand konkreter Beispiele, warum Bayes Methoden insbesondere in der Medizin und Diagnostik zunehmend an Bedeutung gewinnen.

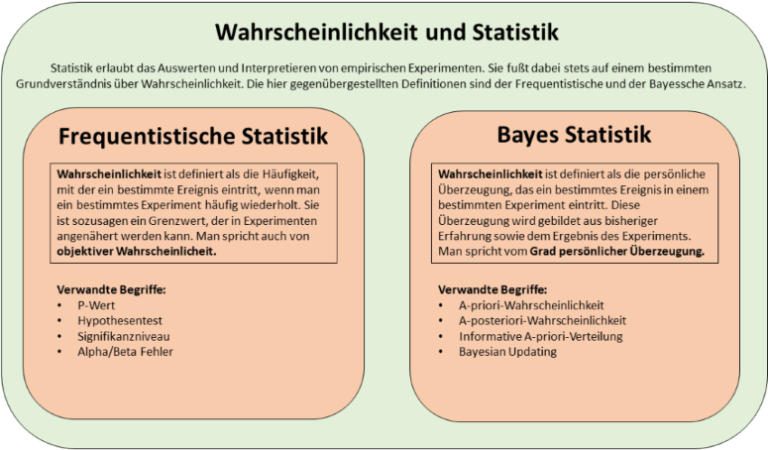

Dabei gilt: Beide Ansätze basieren auf klar definierten mathematischen Regeln und liefern in vielen Alltagssituationen ähnliche Ergebnisse. Die Unterschiede liegen vor allem darin, wie beide Verfahren Wahrscheinlichkeit interpretieren und wie sie mit Vorwissen umgehen.

Wenn Sie dazu Fragen haben, zögern Sie nicht sich bei uns zu melden! Wir bieten professionelle Coachings zu diesen und vielen weiteren Themen rund um Statistik an. Wenden sie sich hierzu an uns für eine professionelle Beratung!

Grundlagen der Bayes Statistik: Die Definition der Wahrscheinlichkeit

Der zentrale Unterschied zwischen klassischer Statistik und Bayes Statistik liegt in der Definition von Wahrscheinlichkeit.

Die frequentistische Statistik interpretiert Wahrscheinlichkeit als relative Häufigkeit eines Ereignisses in vielen Wiederholungen eines Experiments. Die Wahrscheinlichkeit gilt damit als objektive Eigenschaft eines Prozesses.

Die Bayes Statistik betrachtet Wahrscheinlichkeit dagegen als Maß für Unsicherheit beziehungsweise aktuellen Wissensstand. Neue Informationen verändern dabei bestehende Wahrscheinlichkeiten kontinuierlich.

Die Unterschiede wirken auf den ersten Blick größer, als sie in der Praxis häufig sind. Beide Ansätze folgen mathematischen Regeln und führen in vielen Anwendungen zu ähnlichen Ergebnissen. Dennoch unterscheiden sie sich deutlich darin, wie sie statistische Aussagen interpretieren.

Die frequentistische Statistik konzentriert sich ausschließlich auf beobachtete Daten innerhalb eines Experiments oder einer Stichprobe. Zusätzliche Informationen außerhalb der erhobenen Daten fließen nicht direkt in die Berechnung ein.

Die Bayes Statistik kombiniert dagegen vorhandene Erkenntnisse mit neuen Beobachtungen. Dadurch lassen sich Wahrscheinlichkeiten dynamisch aktualisieren. Genau dieser Unterschied spielt insbesondere in der medizinischen Diagnostik, im Machine Learning oder bei kleinen Stichproben eine wichtige Rolle.

Bayes Statistik einfach erklärt

Bedeutung von a priori und a posteriori

Ein zentrales Konzept der Bayes Statistik sind die Begriffe a priori und a posteriori.

Die a priori Wahrscheinlichkeit beschreibt eine Erwartung oder Annahme, bevor neue Daten vorliegen. Diese Erwartung basiert beispielsweise auf bisherigen Studien, Erfahrungswerten oder bekannten Wahrscheinlichkeiten.

Sobald neue Daten hinzukommen, aktualisiert die Analyse diese Annahme. Das Ergebnis bezeichnet man als a posteriori Wahrscheinlichkeit.

Die Bayes Statistik verbindet damit bestehende Erkenntnisse und neue Beobachtungen zu einer aktualisierten Wahrscheinlichkeitsbewertung.

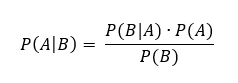

Der Satz von Bayes

Der Satz von Bayes beschreibt mathematisch, wie neue Informationen bestehende Wahrscheinlichkeiten verändern.

Bedeutung der einzelnen Bestandteile:

- P(A|B) beschreibt die Wahrscheinlichkeit von Ereignis A unter der Bedingung, dass Ereignis B eingetreten ist.

- P(B|A) beschreibt die Wahrscheinlichkeit von B, wenn A tatsächlich vorliegt.

- P(A) bezeichnet die sogenannte Prior-Wahrscheinlichkeit, also das Vorwissen vor der Beobachtung neuer Daten.

- P(B) beschreibt die Gesamtwahrscheinlichkeit von Ereignis B.

Praktische Interpretation des Satzes von Bayes

Die Formel zeigt, wie sich Wahrscheinlichkeiten anhand neuer Beobachtungen aktualisieren lassen.

Wenn wir wissen, dass ein bestimmtes Ereignis eingetreten ist, können wir berechnen, wie wahrscheinlich ein anderes Ereignis unter dieser Bedingung wird. Dazu kombiniert die Formel:

- bestehendes Vorwissen,

- beobachtete Daten,

- sowie die Wahrscheinlichkeit bestimmter Beobachtungen.

In der medizinischen Diagnostik hilft diese Berechnung beispielsweise dabei einzuschätzen, wie wahrscheinlich eine Krankheit tatsächlich vorliegt, wenn ein Test positiv ausfällt.

Die Analyse berücksichtigt dabei nicht nur die Genauigkeit des Tests, sondern zusätzlich die Prävalenz der Erkrankung innerhalb der Bevölkerung. Genau dadurch ermöglicht die Bayes Statistik oft realistischere Interpretationen als die reine Betrachtung einzelner Testergebnisse.

Praxisbeispiele der Bayes Statistik

Münzwurf als einfaches Bayes Beispiel

Ein klassisches Beispiel zur Erklärung der Bayes Statistik ist der Münzwurf.

Angenommen, Sie möchten prüfen, ob eine Münze fair ist. Vor dem Experiment gehen Sie davon aus, dass Kopf und Zahl mit gleicher Wahrscheinlichkeit auftreten. Diese Annahme entspricht der a priori Wahrscheinlichkeit.

Nun werfen Sie die Münze viermal und erhalten viermal hintereinander „Zahl“. Dieses Ergebnis wirkt ungewöhnlich, beweist aber noch nicht automatisch, dass die Münze manipuliert wurde.

Die Wahrscheinlichkeit dafür beträgt:

0,5 × 0,5 × 0,5 × 0,5 = 0,0625 = 6,25 %

Der frequentistische Ansatz betrachtet vor allem diese beobachtete Häufigkeit. Auf Basis der wenigen Würfe könnte man deshalb vermuten, dass die Münze nicht vollkommen fair ist.

Die Bayes Statistik geht einen Schritt weiter. Sie kombiniert die neuen Beobachtungen mit der ursprünglichen Annahme, dass Münzen in der Regel fair sind.

Die sogenannte a posteriori Wahrscheinlichkeit für „Kopf“ sinkt dadurch von ursprünglich 50 % auf etwa 43 %. Gleichzeitig steigt die Wahrscheinlichkeit für „Zahl“ auf etwa 57 %.

Die Bayes Statistik liefert damit nicht nur die Aussage, dass die ursprüngliche Annahme möglicherweise nicht mehr zutrifft. Sie ermöglicht zusätzlich eine konkrete Schätzung darüber, wie wahrscheinlich bestimmte Ergebnisse künftig auftreten werden. eine Art Skalierungsfaktor verstanden werden.

Medizinische Diagnostik und seltene Krankheiten

Die Vorteile der Bayes Statistik zeigen sich besonders deutlich in der medizinischen Diagnostik.

Gerade bei seltenen Krankheiten reicht ein positives Testergebnis häufig nicht aus, um zuverlässig auf eine tatsächliche Erkrankung zu schließen. Entscheidend ist zusätzlich die sogenannte Prävalenz, also die Häufigkeit einer Krankheit innerhalb der Bevölkerung.

An dieser Stelle unterscheiden sich Bayes Statistik und frequentistische Statistik deutlich: Die frequentistische Statistik bewertet primär die Eigenschaften des Tests, etwa Sensitivität und Spezifität. Die Bayes Statistik betrachtet dagegen stärker die konkrete Situation einer Person und stellt die Frage: Wie wahrscheinlich ist es, nach einem positiven Testergebnis tatsächlich krank zu sein?

Um diese Wahrscheinlichkeit zu berechnen, kombiniert die Bayes Statistik:

- die Prävalenz der Erkrankung,

- die Sensitivität des Tests,

- die Spezifität des Tests,

- sowie das konkrete Testergebnis.

Ein vereinfachtes Beispiel verdeutlicht den Zusammenhang:

Angenommen, eine seltene Krankheit betrifft 1 von 10.000 Personen. Ein diagnostischer Test besitzt gleichzeitig eine Sensitivität und Spezifität von jeweils 99 %.

Von 10.000 getesteten Personen ist statistisch gesehen nur 1 Person tatsächlich erkrankt. Der Test erkennt diese Person korrekt als positiv.

Gleichzeitig erhalten bei einer Spezifität von 99 % etwa 100 gesunde Personen fälschlicherweise ebenfalls ein positives Testergebnis.

Damit gibt es insgesamt ungefähr:

- 1 korrekt positives Testergebnis,

- sowie 100 falsch positive Testergebnisse.

Die Bayes Statistik berechnet daraus die Wahrscheinlichkeit, nach einem positiven Testergebnis tatsächlich erkrankt zu sein. Die so berechnete Wahrscheinlichkeit bezeichnet man in der medizinischen Diagnostik auch als positiven Vorhersagewert (Positive Predictive Value, PPV):

1 ÷ 101 ≈ 0,99 %

Obwohl der Test also eine Genauigkeit von 99 % besitzt, liegt die tatsächliche Erkrankungswahrscheinlichkeit nach einem positiven Testergebnis nur bei ungefähr 1 %. Genau diesen Zusammenhang berücksichtigt die Bayes Statistik und hilft dadurch, Testergebnisse realistischer einzuordnen und Fehldiagnosen zu vermeiden.

Vergleich zwischen Bayes Statistik und frequentistischer Statistik

Die Tabelle verdeutlicht, dass beide Ansätze unterschiedliche Perspektiven auf statistische Fragestellungen bieten.

| Kriterium | Bayes Statistik | Frequentistische Statistik |

| Verständnis von Wahrscheinlichkeit | Wahrscheinlichkeit beschreibt Unsicherheit und Wissensstand | Wahrscheinlichkeit basiert auf relativen Häufigkeiten |

| Umgang mit Vorwissen | Bereits vorhandene Informationen fließen aktiv in die Analyse ein | Vorwissen wird nicht direkt berücksichtigt |

| Interpretation der Ergebnisse | Wahrscheinlichkeiten werden dynamisch aktualisiert | Ergebnisse basieren ausschließlich auf Stichprobendaten |

| Typische Anwendungen | Medizin, Machine Learning, kleine Stichproben | Klassische Hypothesentests und Standardanalysen |

Die frequentistische Statistik konzentriert sich primär auf beobachtete Daten und statistische Signifikanz innerhalb einer Stichprobe. Die Bayes Statistik kombiniert dagegen vorhandenes Wissen mit neuen Beobachtungen und aktualisiert Wahrscheinlichkeiten dynamisch.

Dadurch eignet sich die Bayes Statistik insbesondere für Anwendungen mit kleinen Stichproben, diagnostischen Fragestellungen oder komplexen Unsicherheiten. Die frequentistische Statistik bleibt dagegen weiterhin der Standard vieler klassischer Hypothesentests und Studienauswertungen.

Stärken und Schwächen der Bayes Statistik

Die Bayes Statistik bietet mehrere wichtige Vorteile. Sie berücksichtigt vorhandenes Wissen bereits vor Beginn einer Analyse und ermöglicht dadurch oft fundierte Aussagen selbst bei kleinen Stichproben. Gerade in der Medizin oder in frühen Forschungsphasen stellt dies einen großen Vorteil dar.

Außerdem interpretieren viele Anwender die Ergebnisse der Bayes Statistik als intuitiver und praxisnäher. Die berechneten Wahrscheinlichkeiten lassen sich häufig direkt auf konkrete Fragestellungen übertragen. Darüber hinaus nutzen moderne Anwendungen wie Machine Learning, künstliche Intelligenz oder adaptive Studiendesigns zunehmend Bayes Methoden.

Trotz ihrer Vorteile bringt die Bayes Statistik auch Herausforderungen mit sich. Die Berechnungen erfordern häufig deutlich mehr Rechenleistung als klassische Verfahren. Zusätzlich beeinflusst die Wahl der a priori Verteilung die späteren Ergebnisse teilweise erheblich. Gerade bei begrenztem Vorwissen kann die Definition geeigneter Prior-Verteilungen schwierig sein. Deshalb erfordert die Anwendung Bayes Methoden oft zusätzliche methodische Erfahrung.

Fazit

Die Bayes Statistik eignet sich besonders gut für Fragestellungen mit Unsicherheit, kleinen Stichproben oder komplexen Entscheidungsprozessen.

Vor allem in der Medizin, Biostatistik, Diagnostik und im Machine Learning gewinnt sie deshalb zunehmend an Bedeutung. Durch die Kombination aus bestehenden Informationen und neuen Daten ermöglicht sie oft individuellere und praxisnähere Interpretationen als klassische Verfahren allein.

Während die frequentistische Statistik primär beobachtete Häufigkeiten betrachtet, aktualisiert die Bayes Statistik Wahrscheinlichkeiten dynamisch anhand neuer Informationen. Dadurch eignet sie sich besonders für Anwendungen, in denen Prävalenzen, individuelle Kontexte oder klinische Zusatzinformationen eine wichtige Rolle spielen.

Unsere Statistiker unterstützen Sie bei der Anwendung moderner statistischer Methoden – von der Bayes Statistik bis hin zu klassischen Hypothesentests und komplexen Datenanalysen.

Wenn Sie prüfen möchten, ob Bayes Methoden zu Ihrem Forschungsprojekt passen, beraten wir Sie gerne individuell und praxisnah.